特徵詞選取概念與實作(2)

延續上一篇內容,接下來介紹DF

DF (Document Frequency)概念也是跟頻率相關, 其概念為字詞在所有文章中,總共在幾篇中有出現過,要注意是 否有做斷句,若有母體就變成句子而不是文章。實作用資料庫很容易就能算出來了,計算某 詞的DF只要從斷詞庫下where條件去看他在哪幾篇文章有出現過。

接著TF-IDF

TF-IDF (Term Frequency–Inverse Document Frequency)結合TF與DF的概念,若一個詞出現的頻率很高表示很重要,但若在每篇文章又常出 現,此詞的代表性可能就沒那麼強,所以權重IDF就是DF倒數取log,取乘積來表示一個詞 的值。

接著TF-ICF

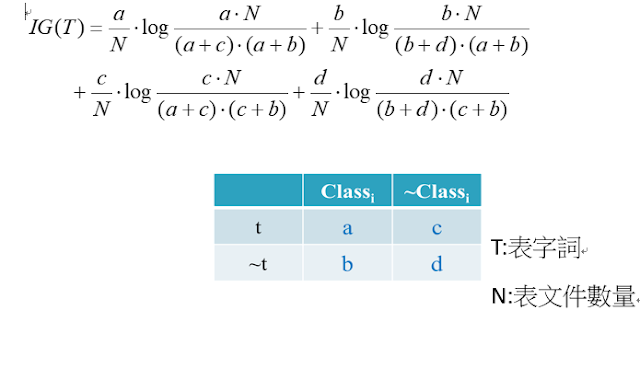

概念類似TF-IDF,只是權重IDF改成ICF,變成此詞若在很多類別出現的話,就不太重要。 接下來介紹IG (Information Gain)當文章有分類的基礎下,IG能夠去計算某詞在此分類時的亂度值,以及不再此分類時的亂 度值,間接能夠看出某詞是不是能夠有代表性某分類文章,因此也能應用在選取特徵詞上, 其公式如圖。

DF (Document Frequency)概念也是跟頻率相關, 其概念為字詞在所有文章中,總共在幾篇中有出現過,要注意是 否有做斷句,若有母體就變成句子而不是文章。實作用資料庫很容易就能算出來了,計算某 詞的DF只要從斷詞庫下where條件去看他在哪幾篇文章有出現過。

接著TF-IDF

TF-IDF (Term Frequency–Inverse Document Frequency)結合TF與DF的概念,若一個詞出現的頻率很高表示很重要,但若在每篇文章又常出 現,此詞的代表性可能就沒那麼強,所以權重IDF就是DF倒數取log,取乘積來表示一個詞 的值。

接著TF-ICF

概念類似TF-IDF,只是權重IDF改成ICF,變成此詞若在很多類別出現的話,就不太重要。 接下來介紹IG (Information Gain)當文章有分類的基礎下,IG能夠去計算某詞在此分類時的亂度值,以及不再此分類時的亂 度值,間接能夠看出某詞是不是能夠有代表性某分類文章,因此也能應用在選取特徵詞上, 其公式如圖。

|

| Information Gain |

留言

張貼留言